Guide d'adoption enterprise — Comment intégrer l'IA agentique NVIDIA en production

De la curiosité au déploiement : guide pratique en 4 phases (Évaluation, Pilote, Scale, Gouvernance) pour intégrer l'IA agentique NVIDIA en production. Cas concrets, erreurs à éviter, checklist 20 points.

Introduction — De l'intérêt à la production

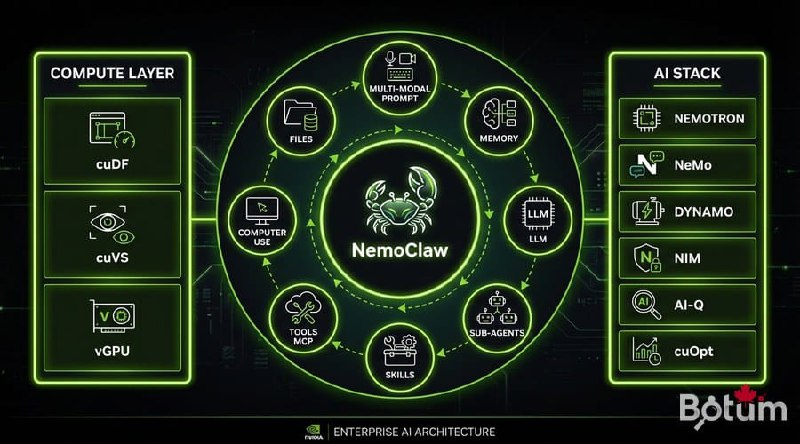

Au GTC 2026, NVIDIA a confirmé que l'IA agentique n'est plus un sujet de laboratoire : c'est une réalité de production. NVIDIA Agent Intelligence Toolkit, NIM, NemoClaw, Blueprints agentiques — les briques sont là. La vraie question est : comment votre entreprise passe-t-elle de la curiosité au déploiement ?

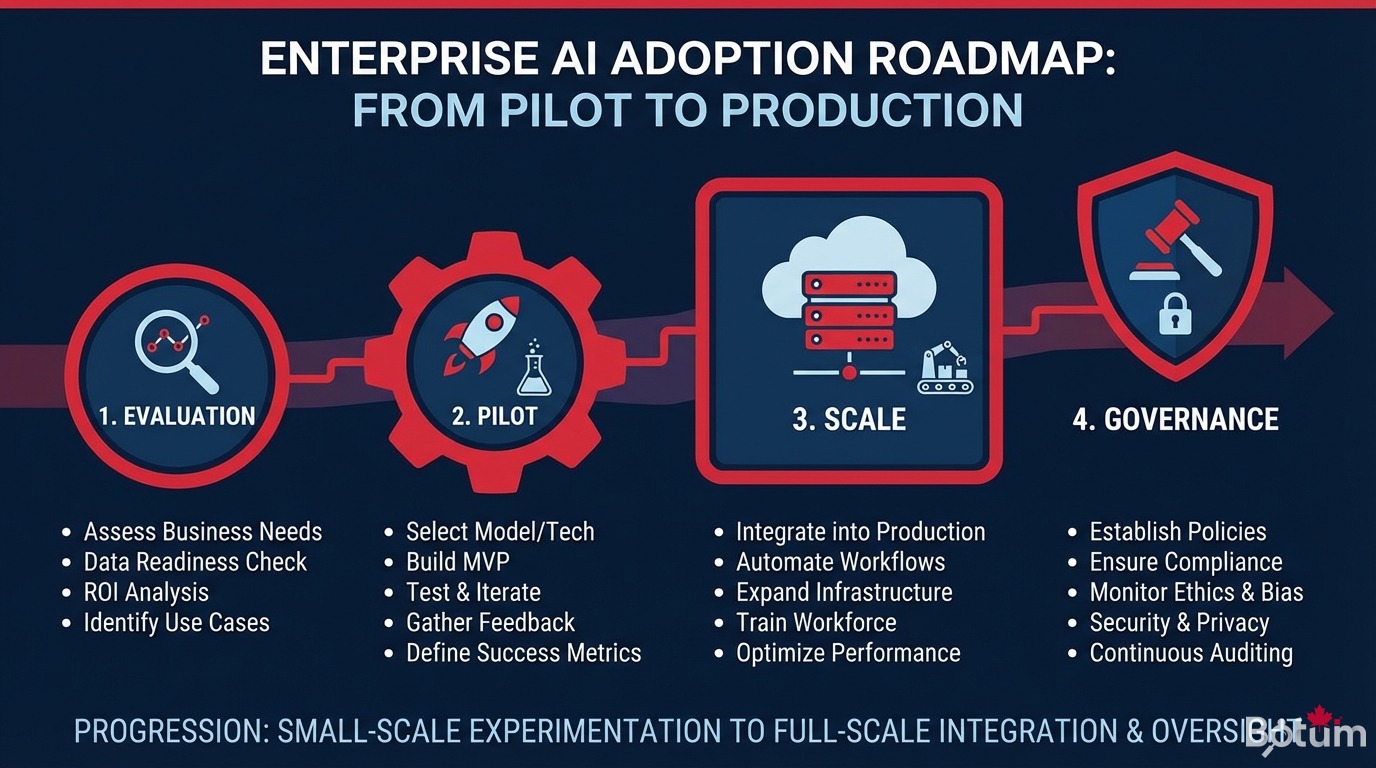

Ce guide s'adresse aux architectes solutions et DSI qui doivent prendre des décisions concrètes. Il structure le parcours en 4 phases : Évaluation → Pilote → Scale → Gouvernance. Chaque phase contient des actions précises, des critères de succès et des pièges à éviter.

Série GTC 2026

Phase 1 : Évaluation — Identifier les bons cas d'usage

La majorité des projets IA enterprise échouent non pas à cause de la technologie, mais à cause d'un mauvais choix de cas d'usage au départ. L'évaluation doit être méthodique.

Critères de sélection d'un cas d'usage pilote

| Critère | Bon signe ✅ | Mauvais signe ⚠️ |

|---|---|---|

| Volume de tâches | > 100 tâches/jour répétitives | Tâches rares ou très variables |

| Qualité des données | Données structurées disponibles | Données silotées ou manquantes |

| Tolérance à l'erreur | Erreur = coût négligeable | Erreur = risque légal ou sécurité |

| Mesurabilité | KPI clair (temps, coût, qualité) | Impact diffus, non mesurable |

| Support métier | Champion métier identifié | Projet IT sans sponsor business |

Cas d'usage enterprise validés GTC 2026

- Support client niveau 1 : agent NIM + RAG sur base de connaissances interne (ROI 3-6 mois)

- Analyse documentaire : contrats, RFP, rapports — agent Blueprint avec LLM NIM local

- Monitoring IT proactif : agent surveillance + escalade automatique via NeMo Guardrails

- Onboarding employés : parcours guidé par agent multi-étapes avec validation humaine

- Génération de rapports : agrégation données + rédaction automatique avec supervision

Signal BOTUM : les entreprises qui réussissent choisissent un cas d'usage où l'agent augmente un humain, plutôt que de le remplacer entièrement. L'adoption interne est 3x plus rapide.

Phase 2 : Pilote — Valider avec un projet concret

Le pilote n'est pas un POC. Un POC prouve que la technologie fonctionne. Un pilote prouve que votre organisation peut l'opérer. La différence est fondamentale.

Stack technique recommandée pour le pilote

| Composant | Recommandation BOTUM | Alternative |

|---|---|---|

| LLM inference | NVIDIA NIM (cloud ou on-prem) | API OpenAI / Anthropic |

| Orchestration agents | LangGraph + NVIDIA Agent Toolkit | CrewAI, AutoGen |

| RAG / mémoire | FAISS ou Milvus + NeMo Retriever | Chroma, Weaviate |

| Guardrails | NeMo Guardrails (obligatoire) | Regex + filtre maison (insuffisant) |

| Observabilité | Langfuse ou LangSmith | Logs JSON custom |

| Infrastructure | AWS ou Azure (GPU à la demande) | On-prem si > 50k req/j |

Critères de succès du pilote (90 jours)

- Performance : taux de succès tâche > 80% (défini avant le lancement)

- Adoption : > 70% des utilisateurs cibles l'utilisent activement après 30 jours

- Coûts : coût par tâche agent < coût par tâche humaine (ou temps libéré > 20%)

- Fiabilité : uptime > 99% sur les 30 derniers jours du pilote

- Guardrails : 0 incident de contenu inapproprié ou de fuite de données

Phase 3 : Scale — Passer de 1 à N agents en production

Le passage du pilote à la production est le moment où la majorité des projets IA enterprise se bloquent. La technologie fonctionne, mais l'organisation n'est pas prête.

Architecture de production : ce qui change vs le pilote

- Haute disponibilité : 2 régions minimum, failover automatique, SLA 99,9%

- Autoscaling GPU : capacité à multiplier par 10 en < 5 minutes (cloud obligatoire)

- Pipeline CI/CD agents : déploiement zero-downtime, tests automatisés, rollback instantané

- Observabilité production : traces distribuées, alertes latence/erreur, dashboards métier

- Cache sémantique : réutiliser les réponses similaires = -40 à -60% de coûts GPU

- Rate limiting : quotas par utilisateur/service pour protéger l'infrastructure

Modèle organisationnel : l'équipe AI Ops

| Rôle | Responsabilité | Profil |

|---|---|---|

| AI Ops Lead | SLA, incidents, budget GPU | DevOps senior + formation LLM |

| Prompt Engineer | Optimisation prompts, évaluations | Dev Python + linguistique |

| Data Steward | Qualité données, RGPD, RAG | Data analyst + juridique |

| Business Owner | KPI métier, priorisation | Directeur ou manager métier |

| AI Security | Guardrails, audit, red team | SecOps + formation adversarial AI |

Benchmark BOTUM : un agent de support client bien optimisé traite 500-800 conversations/heure sur un GPU H100. Calculez votre break-even vs agents humains à ce ratio.

Phase 4 : Gouvernance — Contrôler, auditer, sécuriser

La gouvernance n'est pas une phase qui vient après la production : elle doit être intégrée dès le pilote. Mais c'est en production qu'elle prend toute son importance.

Cadre de gouvernance IA enterprise BOTUM

- Politique d'utilisation acceptable : ce que les agents peuvent et ne peuvent pas faire (documenté, validé juridique)

- Registre des agents : inventaire de tous les agents en production, leurs accès, leurs capacités

- Audit trail complet : chaque décision d'agent tracée, horodatée, exportable pour audit

- Human-in-the-loop : processus de validation humaine pour les décisions à impact élevé

- Red teaming régulier : tests d'adversarial prompting trimestriels

- Mise à jour des modèles : processus de validation avant chaque mise à jour de LLM en production

Conformité RGPD

- Ne jamais envoyer de données personnelles identifiables (DPI) à un LLM externe sans consentement

- NIM local ou VPC privé pour les données sensibles : santé, finance, RH

- Droit à l'explication obligatoire si l'agent affecte un individu

- Rétention des logs recommandée : 12 mois minimum

- DPO impliqué dans toute nouvelle capacité agent

Erreurs classiques à éviter

| Erreur | Symptôme | Solution |

|---|---|---|

| Trop grand trop vite | Pilote sur 20 cas d'usage en parallèle | Max 2 cas d'usage phase 1 |

| Pas de guardrails | Agent répond n'importe quoi | NeMo Guardrails obligatoire |

| Données non préparées | RAG qui hallucine 30% du temps | Audit données avant le pilote |

| Pas de champion métier | Adoption < 20% après 3 mois | Business owner obligatoire |

| Lock-in modèle | Dépendance totale à GPT-4 | Abstraction LLM (LiteLLM) |

| Ignorer les coûts GPU | Facture cloud x5 vs estimation | FinOps GPU dès le pilote |

| Oublier la sécurité | Injection de prompt par utilisateurs | Tests adversariaux pre-launch |

Checklist finale — 20 questions avant le go-live

Évaluation & Architecture

- ☐ Le cas d'usage a un KPI mesurable et un sponsor métier identifié ?

- ☐ L'audit des données est complété (qualité, périmètre, RGPD) ?

- ☐ L'architecture NIM + orchestrateur + RAG est documentée ?

- ☐ Les coûts GPU ont été estimés et un budget cloud est approuvé ?

- ☐ Un fallback humain est prévu pour les cas limites ?

Sécurité & Conformité

- ☐ NeMo Guardrails est configuré et testé ?

- ☐ Les tests d'injection de prompt ont été réalisés ?

- ☐ La politique DPI est validée par le DPO ?

- ☐ L'audit trail est actif et exportable ?

- ☐ Le registre des agents est créé ?

Opérations & Scale

- ☐ L'observabilité (traces, métriques, alertes) est en place ?

- ☐ Un pipeline CI/CD avec tests automatisés est configuré ?

- ☐ Le runbook d'incident est écrit ?

- ☐ L'équipe AI Ops est formée et les astreintes définies ?

- ☐ La procédure de rollback est testée ?

Adoption & Gouvernance

- ☐ La formation des utilisateurs finaux est planifiée ?

- ☐ Un processus de feedback utilisateur est en place ?

- ☐ La politique d'utilisation acceptable est communiquée à tous ?

- ☐ Un comité de revue IA trimestriel est planifié ?

- ☐ Le plan de montée en charge (Scale) est documenté ?

📥 GUIDE COMPLET — GTC 2026 · Billet B5

⬇ Télécharger le guide (PDF)🚀 Aller plus loin avec BOTUM

Ce guide couvre les fondamentaux de l'adoption IA agentique enterprise. En production, chaque décision a ses spécificités — gouvernance, sécurité, FinOps GPU. Les équipes BOTUM accompagnent les DSI de l'évaluation au go-live. Parlons-en.

Discuter de votre projet →