OpenClaw vs ChatGPT vs Claude API : comparatif honnête pour les entreprises

ChatGPT, Claude API ou OpenClaw self-hosted ? BOTUM compare les trois outils sans parti pris — pour que les DSI et directeurs IT choisissent avec les bons critères. Tableau comparatif, scénarios enterprise et recommandations concrètes.

La question que tout DSI finit par poser : "Pourquoi ne pas juste utiliser ChatGPT ?" La réponse honnête : ça dépend. Ce billet compare trois outils réels, sans parti pris — pour que vous puissiez choisir en connaissance de cause.

1. La vraie question derrière "Pourquoi pas ChatGPT ?"

Quand un directeur informatique pose cette question, il ne demande pas vraiment "ChatGPT est-il mauvais ?". Il demande : est-ce que le gain en contrôle et en flexibilité vaut l'investissement en infrastructure ?

La réponse honnête : parfois oui, parfois non. Tout dépend du cas d'usage, des contraintes réglementaires, du volume et de la sensibilité des données manipulées.

Ce comparatif ne cherche pas à désigner un gagnant absolu. Il trace les contours de trois outils distincts, avec leurs forces réelles et leurs limites réelles — pour que les décideurs puissent choisir avec les bons critères.

2. Les trois profils

ChatGPT / GPT-4 — Le généraliste SaaS

ChatGPT est une interface conversationnelle hébergée par OpenAI. C'est l'outil qui a démocratisé l'IA générative grand public. Sa force principale : la facilité d'accès. Aucune infrastructure à gérer, aucune configuration. On ouvre un navigateur, on pose une question, on obtient une réponse.

Forces :

- Zéro friction à l'adoption — utilisable en 2 minutes

- Interface intuitive, connue des équipes non techniques

- GPT-4 reste un des modèles les plus capables pour la rédaction, la synthèse et le code généraliste

- Intégrations natives (Microsoft 365 Copilot, plugins, API)

- Plugins et fonctionnalités qui évoluent rapidement

Limites :

- Pas de mémoire persistante par défaut (chaque conversation repart de zéro)

- Données envoyées sur l'infrastructure OpenAI — problématique pour les données sensibles

- Pas d'accès autonome à votre environnement (fichiers, APIs, commandes shell)

- Coût SaaS qui s'accumule à l'échelle d'une organisation

- Comportement du modèle peut changer d'une mise à jour à l'autre

Cas d'usage idéaux : brainstorming, rédaction rapide, Q&A interne non sensible, support de premier niveau, exploration ad hoc.

Claude API (Anthropic direct) — L'API brute

Claude est le modèle d'Anthropic, reconnu pour sa capacité à traiter de longs documents et pour son alignement constitutionnel. L'API directe s'adresse aux équipes techniques qui veulent intégrer un LLM dans leurs applications — sans interface frontale.

Forces :

- Fenêtre de contexte très longue (jusqu'à 200K tokens sur Claude 3) — idéal pour les documents volumineux

- Qualité de raisonnement reconnue, particulièrement sur les tâches analytiques complexes

- Pricing à l'usage (tokens) — prévisible pour les volumes maîtrisés

- Contrôle fin des paramètres via API (température, system prompt, stop sequences)

- Disponible dans plusieurs régions AWS Bedrock pour la conformité

Limites :

- API brute — nécessite une équipe de développement pour l'intégration

- Pas d'orchestration d'agents native — il faut construire la logique autour

- Données transmises à Anthropic (ou à AWS selon la région)

- Pas d'interface utilisateur — l'UX est entièrement à votre charge

- Pas de mémoire persistante native — à implémenter côté applicatif

Cas d'usage idéaux : analyse de documents longs, intégration dans des applications métier existantes, cas où la qualité de raisonnement prime sur la vitesse.

OpenClaw (self-hosted + LLM au choix) — Le runtime enterprise

OpenClaw n'est pas un LLM. C'est un runtime d'agents IA self-hosted — une plateforme qui orchestre des agents autonomes dans votre infrastructure. Il est LLM-agnostique : vous connectez le modèle de votre choix (Claude, GPT-4, Gemini, ou un modèle local via Ollama).

Forces :

- Self-hosted — vos données restent dans votre réseau

- LLM-agnostique — vous choisissez et changez de modèle sans refactoring

- Mémoire persistante native — workspace Git versionné entre les sessions

- Multi-agents — réseau d'agents spécialisés avec protocoles de communication

- Accès système réel — fichiers, shell, APIs, navigateur, Docker

- Skills modulaires — email, calendrier, GitHub, facturation...

- Coût maîtrisé — vous ne payez que les tokens LLM utilisés

Limites :

- Courbe d'apprentissage initiale — configuration requise

- Requiert une infrastructure (VM, serveur) et des compétences DevOps

- Pas d'interface graphique clé en main — interaction via messagerie

- La qualité dépend du LLM choisi — OpenClaw ne remplace pas un bon modèle

Cas d'usage idéaux : automatisation d'opérations sensibles, réseaux d'agents multi-domaines, organisations avec contraintes de souveraineté des données, environnements où le vendor lock-in est inacceptable.

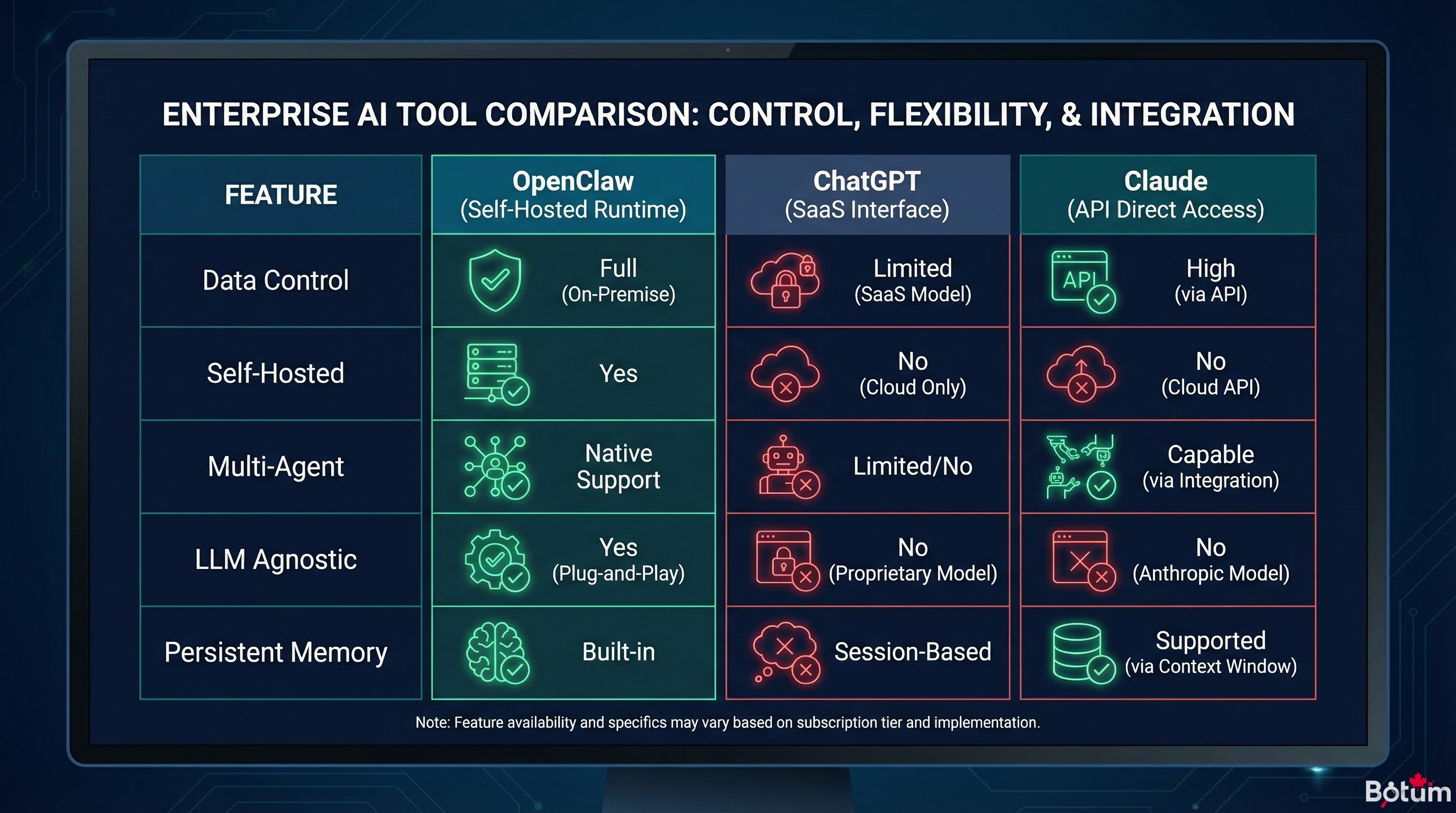

3. Tableau comparatif

| Critère | ChatGPT | Claude API | OpenClaw |

|---|---|---|---|

| Contrôle des données | ❌ SaaS OpenAI | ⚠️ API Anthropic | ✅ Self-hosted |

| Self-hosted | ❌ | ❌ | ✅ |

| LLM-agnostique | ❌ GPT only | ❌ Claude only | ✅ Au choix |

| Mémoire persistante | ⚠️ Limitée | ❌ À implémenter | ✅ Native (Git) |

| Multi-agents | ❌ | ⚠️ Custom dev | ✅ Natif |

| Accès système | ❌ | ❌ | ✅ Shell, fichiers, APIs |

| Facilité d'adoption | ✅ Immédiate | ⚠️ Dev requis | ⚠️ Config requise |

| Coût à l'échelle | ⚠️ Abonnement | ✅ Tokens usage | ✅ Tokens + infra |

| Intégrations natives | ✅ Microsoft 365, plugins | ⚠️ API custom | ✅ Skills modulaires |

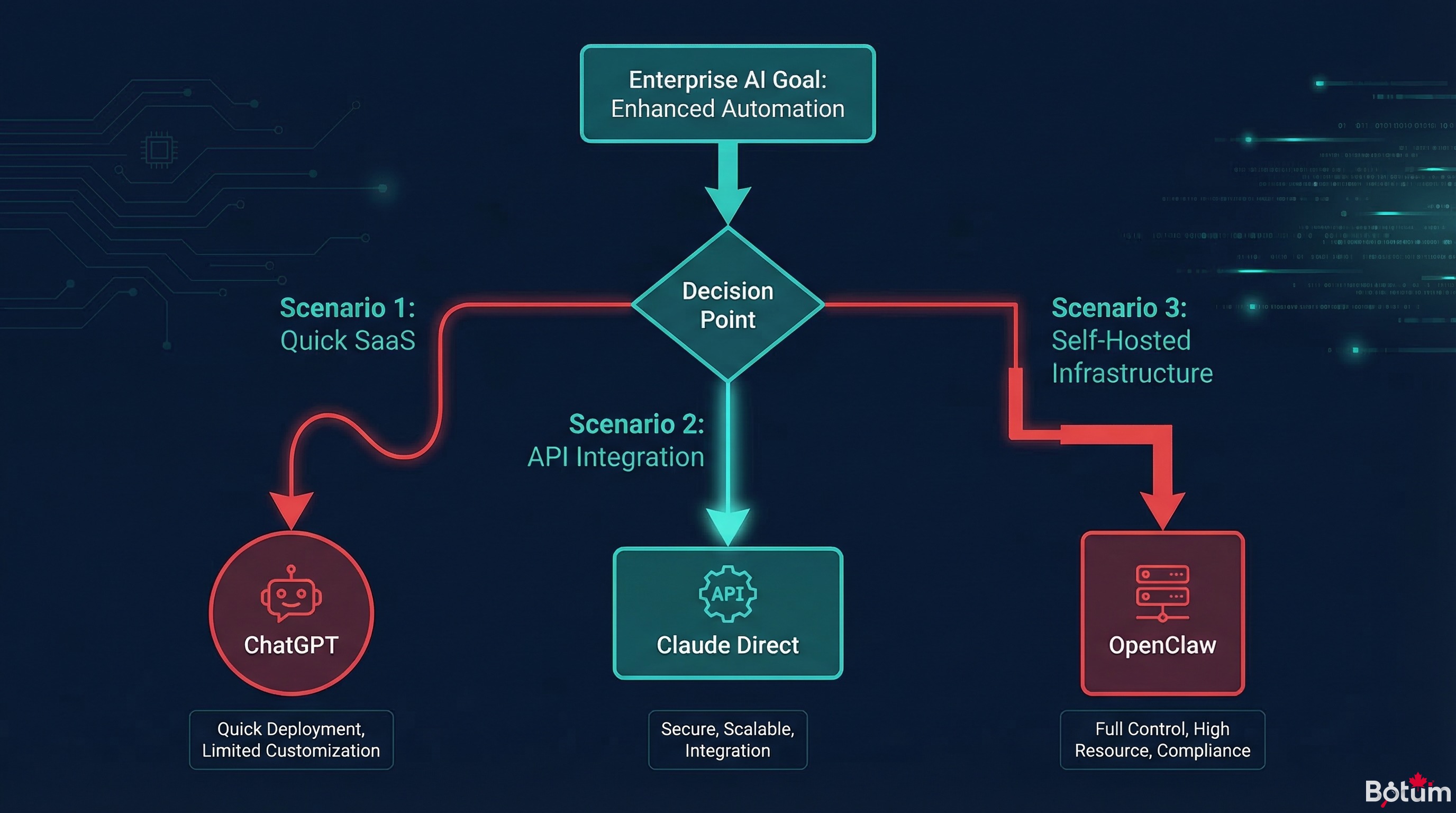

4. Quand choisir quoi — 3 scénarios concrets

Scénario 1 : PME de 50 personnes, équipe non technique, besoin d'aide à la rédaction et à la synthèse

Recommandation : ChatGPT Enterprise

L'adoption est immédiate, l'interface est connue, et les besoins ne justifient pas l'overhead d'une infrastructure dédiée. Les données traitées sont peu sensibles (rédaction, résumés internes). Le coût par utilisateur est prévisible. C'est le bon outil pour ce profil.

Scénario 2 : Cabinet conseil, analyse de contrats volumineux, intégration dans un workflow existant

Recommandation : Claude API

La fenêtre de contexte longue de Claude est un avantage concret pour les documents juridiques ou financiers volumineux. L'équipe technique peut intégrer l'API dans leur workflow de traitement documentaire. Les données ne sont pas ultra-sensibles mais nécessitent un niveau de contrôle que le SaaS grand public ne garantit pas.

Scénario 3 : Scale-up tech, automatisation d'opérations internes (email, facturation, monitoring), données clients sensibles

Recommandation : OpenClaw self-hosted

L'accès système réel, la mémoire persistante et la capacité multi-agents sont nécessaires. Les données clients ne peuvent pas quitter l'infrastructure. Le LLM-agnostique permet d'optimiser coût/performance par tâche. L'investissement initial en configuration est compensé par l'automatisation durable.

5. Le cas enterprise spécifique — pourquoi le self-hosted gagne sur les usages sensibles

Pour les organisations avec des contraintes réglementaires fortes (RGPD strict, secteur financier, santé, juridique), le choix n'est pas toujours une question de préférence — c'est une question de conformité.

Quand un agent IA accède à des données client, des documents contractuels, des logs de production ou des credentials système, la question "où transitent ces données ?" n'est pas optionnelle. La réponse "sur les serveurs d'un fournisseur américain" peut être un bloquant réglementaire ou simplement un risque que le RSSI ne peut pas accepter.

Le self-hosted avec OpenClaw résout ce problème structurellement : seuls les prompts (question + contexte minimal) quittent votre réseau vers le fournisseur LLM. Les données sources restent sur votre infrastructure. Et si vous utilisez un modèle local via Ollama — rien ne sort du tout.

C'est une différence d'architecture fondamentale, pas une question de trust envers les fournisseurs SaaS.

6. La vraie question — ce n'est pas "lequel est meilleur"

Le débat "ChatGPT vs Claude vs OpenClaw" est souvent mal posé. Ce ne sont pas trois concurrents qui se battent pour le même marché — ce sont trois types d'outils qui répondent à des besoins différents.

ChatGPT est un outil d'interface. Claude API est un composant d'intégration. OpenClaw est une plateforme d'automatisation.

En réalité, ces trois outils peuvent coexister dans la même organisation :

- ChatGPT pour les besoins quotidiens ad hoc des équipes

- Claude API intégré dans les applications métier qui traitent des documents

- OpenClaw orchestrant les opérations automatisées avec Claude comme modèle principal

La question n'est pas "lequel choisir" — c'est "pour quel usage, avec quelles contraintes".

🚀 Aller plus loin avec BOTUM

Ces comparatifs simplifient volontairement la réalité. En production, le choix d'outillage IA dépend de votre stack, de vos contraintes réglementaires et de vos flux de données. Les équipes BOTUM ont déployé ces architectures dans des environnements enterprise réels — et connaissent les pièges que les benchmarks ne montrent pas.

Discuter de votre projet →Conclusion

Choisir entre ChatGPT, Claude API et OpenClaw, c'est d'abord répondre à trois questions : Où sont mes données ? Quelle autonomie ai-je besoin ? Qui maintient l'infrastructure ?

Si les réponses sont "chez un tiers, ça m'est égal", "juste une interface de Q&A" et "personne, je veux zéro ops" — ChatGPT. Si c'est "je construis une application" et "Claude me convient" — l'API directe. Si c'est "chez moi", "accès système complet" et "j'ai une équipe technique" — OpenClaw.

→ Billet 7 à venir : OpenClaw + DeepSeek — déployer un modèle local haute performance dans un réseau d'agents enterprise.

📄 Télécharger ce billet en PDF

Version hors-ligne de ce comparatif — inclut le tableau complet et les scénarios d'usage.

Télécharger le PDF →